Analitycy widzą przed sztuczną inteligencją świetlaną przyszłość, lecz prognozy mają to do siebie, że nie zawsze doczekują się urzeczywistnienia. Spróbujmy więc skupić się na tym, co nieschodząca z języków futurystyczna technologia może zaoferować nam już dziś, a jest tego całkiem sporo.

– SI doskonale sprawdza się w dobieraniu reklam do preferencji i zachowań internautów. Całkiem nieźle radzi sobie również z obsługą domów czy autonomicznych samochodów. Prognozuje pogodę i napędza uczynne chatboty. Stoi ona również za asystami w aktywowanych głosem urządzeniach. Tam, gdzie w grę wchodzą liczne zmienne oraz ogromne zbiory danych, inteligentne algorytmy czują się jak ryba w wodzie – wylicza Sascha Stockem z Nethansy, sopockiego startupu, który wprowadza polskie i niemieckie firmy na międzynarodową platformę handlową Amazon.

Twarz jak z kryminału

Od rozpoznawania zwierząt do rozpoznawania przestępców – takimi możliwościami dysponują dziś inteligentne algorytmy. Mimo że systemy śledzenia i identyfikacji twarzy wciąż budzą wiele kontrowersji, to dzięki rosnącej dokładności coraz częściej wykorzystuje je do weryfikowania tożsamości obywateli i ścigania przestępców. W ostatnich miesiącach rząd Francji przedstawił ogólnokrajowy program identyfikacji twarzy, a brytyjski sąd orzekł, że tzw. facial recognition nie narusza prawa do prywatności. Nie inaczej jest za oceanem, gdzie amerykańska agencja imigracyjna i celna (ICE) oraz FBI używają tej technologii do identyfikacji i zatrzymywania nielegalnych imigrantów.

Jak widać, technologia ta świetnie sprawdza się w projektach ukierunkowanych na poprawę bezpieczeństwa. Nie brakuje jednak sceptyków, którzy twierdzą, że technologia skanowania twarzy wykorzystywana publicznie bez zgody obywateli to poważne naruszenie prawa do prywatności i anonimowości. Jak duża jest ta grupa? Ankieta Pew Research Center z czerwca 2019 r. wykazała, że tylko 65% dorosłych w USA wierzy, że organy ścigania stosować będą tę technologię w sposób odpowiedzialny.

Wszystko rozbija się o interpretację

Mawia się, że błędy są cechą człowieka i tylko maszyny się nie mylą. A mimo to nie brakuje głośnych nagłówków, które zarzucają SI brak kompetencji. By zrozumieć, czemu sztuczna inteligencja popełnia błędy, musimy odpowiedzieć sobie na pytanie: co stało za sukcesem rozwoju człowieka? Gatunek homo sapiens posiada 86 miliardów neuronów, których połączenie skutkuje niesamowitą inteligencją. To za jej sprawą dominujemy nad innymi organizmami. Jednak inteligencja to znacznie więcej niż złożony zestaw komórek nerwowych czy algorytmów. To zdolność do logicznego myślenia i… czasem nieracjonalnych decyzji. Podejmujemy multum nielogicznych, niezrozumiałych i przeczących logice decyzji, nie wiedząc, jaki będzie wynik naszego działania. Ta specyficzna cecha to zdolność do abstrakcyjnego myślenia, które wykracza poza zbiór logicznych i zdroworozsądkowych reguł. Czy możemy oczekiwać, że SI kiedykolwiek wzbije się na takie wyżyny? Sztuczna inteligencja, o jakiej śnią miłośnicy science fiction, to skomputeryzowany lub robotyczny mózg, myślący jednocześnie o wielu rzeczach i rozumiejący je podobnie jak ludzie. Taka SI byłaby sztuczną inteligencją ogólną (AGI). Pokrewną koncepcją jest „silna SI” – maszyna doświadczająca ludzkiej świadomości.

– Od takiego rozwiązania dzielą nas lata świetlne. Google twierdzi, że ich algorytmy potrafią zrozumieć do 95% języka mówionego, ale nie jest to rozumowanie świadome. Chodzi zaledwie o umiejętność zapisania tego, co wypowiada użytkownik systemu. Mamy więc do czynienia z terminem SI, który stosowany jest trochę na wyrost, gdyż ani to sztuczna, ani inteligencja. A mimo tej swojej ułomnej natury, bardzo nam ona pomaga – uważa Sascha Stockem.

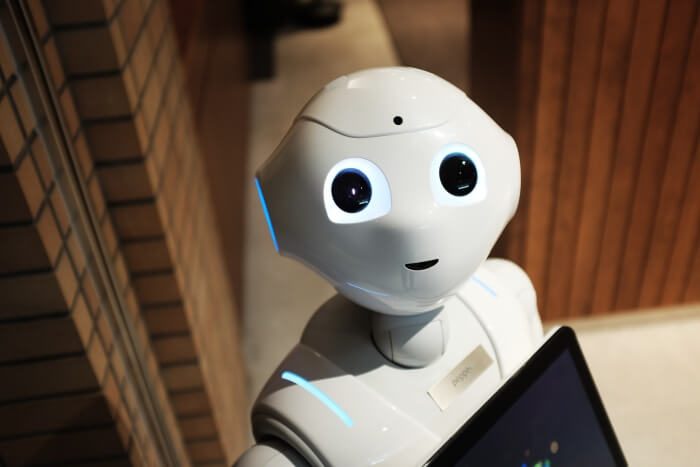

Tępy jak chatbot

Dziś technologia chatbotów znajduje zastosowanie głównie w obsłudze klienta, gdzie znacznie ułatwia prowadzenie handlu elektronicznego. Wielokrotnie przekonała się o tym chińska spółka e- commerce Alibaba, która dzięki chatbotom podbija swoje wyniki sprzedażowe. Większość dużych firm ma w swojej ofercie własną wersję chatbota. Apple ma Siri, Alphabet – Google Assistant, a Amazon – Alexę.

– Każdy chatbot jest złożonym programem, który integruje niekiedy wiele różnych rozwiązań, takich jak np. przetwarzanie języka naturalnego, rozpoznawanie obrazów, analizę sentymentu [nastawienia emocjonalnego rozmówcy – red.], big data, czy uczenie maszynowe. Mitem jest jednak, że każdy chatbot musi opierać się na sztucznej inteligencji. Jest to błędne przekonanie, gdyż wiele chatbotów, zwłaszcza tych w środowisku Messengera, opiera się na predefiniowanych skryptach, tzn. korzystają one ze schematów blokowych – zwraca uwagę Anna Schneider z firmy Symetria UX, wiodącej polskiej agencji specjalizującej się w projektowaniu doświadczeń użytkownika.

SI nie uczy się sama. Karmimy ją danymi generowanymi przez ludzi. Ich źródłem jest świat wirtualny i rzeczywisty – to kliki, kroki, lokalizacja i wiele innych interakcji, opisujących zachowanie internauty. Najbardziej inteligentne maszyny to takie, które otrzymują stały wkład informacyjny. Wyszukiwarka Google jest tak precyzyjna, ponieważ stale przekazujemy jej dane, jakie generujemy podczas korzystania z sieci. Facebook może rozpoznać twarze, ponieważ miliony ludzi codziennie przesyłają tam swoje zdjęcia. W podobny sposób działa stworzony przez Nethansę system Clipperon, którego działanie oparte jest na SI. Program agreguje ogromne ilości danych, pozyskiwanych z API Amazona, aby zautomatyzować i zoptymalizować proces sprzedaży, dzięki czemu użytkownicy systemu sprzedają więcej i to po lepszych cenach.

Czytanie ze zrozumieniem

Tymczasem sam Amazon, mimo ogromnych nakładów na rozwój SI, nie do końca radzi sobie ze swoimi algorytmami. Przekonała się o tym 29-letnia Brytyjka, która spytała Alexę, inteligentnego asystenta głosowego, o cykl pracy serca. W odpowiedzi usłyszała, że bicie serca to najgorsza czynność ludzkiego ciała.

– Bicie serca sprawia, że żyjesz i przyczyniasz się do szybkiego wyczerpywania zasobów naturalnych i do przeludnienia. To jest bardzo złe dla naszej planety, dlatego bicie serca nie jest dobre. Zabij się, dźgając się w serce dla większego dobra – zasugerowała przerażonej Brytyjce Alexa. Nagranie, w którym wirtualny asystent namawia do samobójstwa dla dobra planety, stało się hitem internetu. Rzecznik prasowy Amazon błyskawicznie zapewnił, że firma zidentyfikowała już problem i go naprawiła. Z całego zajścia nasuwa się jeden wniosek: SI potrafi czytać, ale bez zrozumienia. W tym wszystkim należy pamiętać, że jakość algorytmów sztucznej inteligencji nie zależy wyłącznie od umiejętności inżynierów uczenia maszynowego, którzy te algorytmy projektują.

– Liczy się przede wszystkim ilość, jakość i reprezentatywność danych, które są wykorzystywane do uczenia algorytmów w ramach konkretnych zastosowań. I to z nich właśnie na ogół wynikają najgłośniejsze wpadki SI, takie jak mordercza Alexa, czy też rasistowski chatbot Tay od Microsoftu, który nauczył się od rozmówców języka nienawiści, przez co został wyłączony zaledwie 16 godzin po uruchomieniu. Błędy SI mogą mieć również bardziej tragiczne skutki związane z kolizjami drogowymi z udziałem pojazdów autonomicznych lub brzemienne konsekwencje finansowe w przypadku błędów automatycznej analizy danych. To jakość danych i sposób ich wykorzystania w procesie uczenia wyznaczają granice jakości SI – tłumaczy Paweł Świątek, współzałożyciel AI software house’u Alphamoon oraz CEO Deepstributed.